NvidiaがOpenAI・Anthropicから距離を置き始めた — ジェンセン・ファンの発言が示すAIインフラ戦略の地殻変動

TechCrunchが報じたNvidiaの出資縮小ニュースを深掘り。ジェンセン・ファンの発言の真意、各メディアの分析、開発者コミュニティの反応、そして日本のBtoB企業への示唆をまとめた。

エンジニアのゆとです。

2026年3月4日、サンフランシスコで開催されたMorgan Stanley Technology, Media & Telecom ConferenceでNvidiaのCEOジェンセン・ファンが重要な発言をしました。OpenAIへの$300億(約4.7兆円)出資が「最後かもしれない(might be the last time)」、当初の最大$1,000億の投資計画は「もう実現しないだろう(not in the cards)」と明言。Anthropicへの約$100億の出資も「おそらく最後になるだろう」と述べました。

TechCrunchは「raises more questions than it answers(答えより多くの疑問を生む)」と評し、メディアもコミュニティも解釈が割れています。

この記事では、各メディアの報道、開発者コミュニティの反応、そしてこの動きが日本のBtoB企業にどう影響し得るかを整理します。

何が起きたのか: ジェンセン・ファンの発言

2026年3月初旬、NvidiaのCEOジェンセン・ファンは公の場で、OpenAIおよびAnthropicへの投資を「最後」にする可能性を示唆しました。

TechCrunchの報道によると、ファンは両社への出資縮小を明言したものの、その理由については曖昧な説明にとどまった。記事は「raises more questions than it answers」と評しています。

PYMNTS.comは「Nvidia Signals Final Investments in OpenAI and Anthropic」というタイトルで報じ、Technology.orgは「Nvidia Quietly Steps Away」とより控えめな表現を使った。メディアによって温度感が異なるのは、ファンの発言自体が意図的に曖昧だった可能性を示唆しています。

背景を理解するための数字

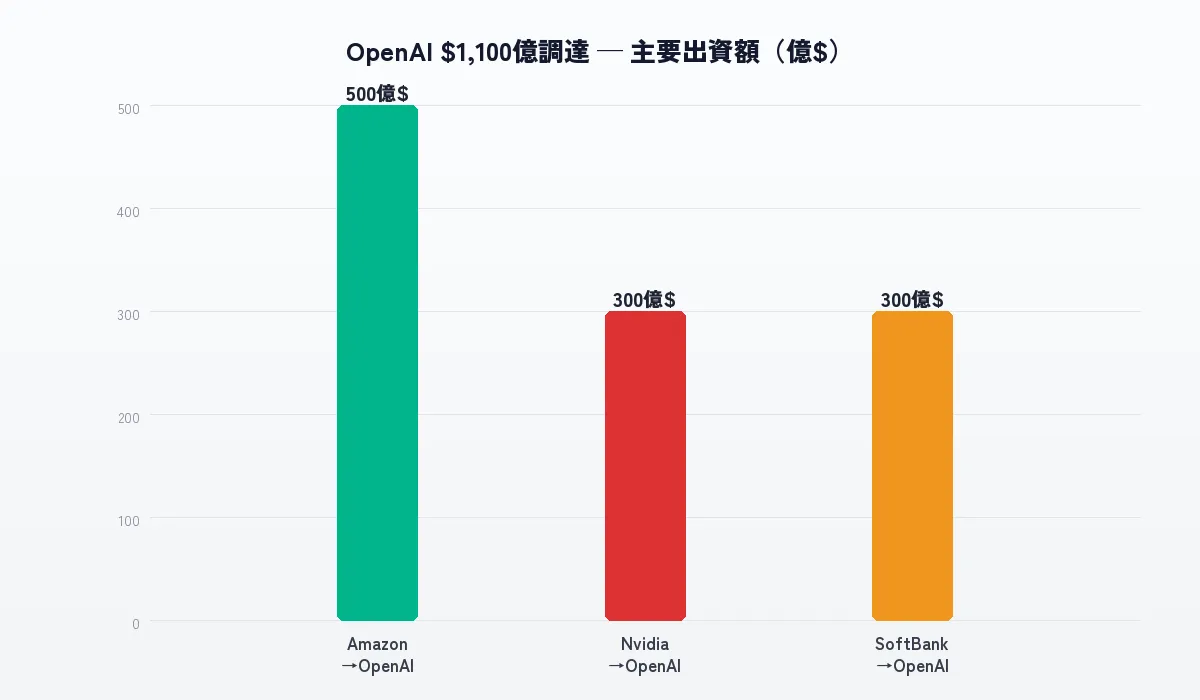

この動きを理解するには、関係する資本の規模を把握しておく必要があります。

- Nvidia FY2026通期売上: $2,159億(前年比+65%)、データセンター事業だけで$623億(Q4、前年同期比+75%)

- Nvidia時価総額: 約$4.41兆(2026年3月6日時点)

- OpenAIの最新調達: $1,100億(ポストマネー評価額$8,400億)

- Anthropicの最新調達: Series Gで$300億(評価額$3,800億、2025年9月の$1,830億から2倍超)

- ハイエンドGPU(H100/B100)の単価: 1枚$30,000〜$40,000

NvidiaはOpenAIとAnthropicの最大のサプライヤーであると同時に、出資者でもありました。「買い手であり投資先」という複雑な関係です。

各メディアの分析: 3つの仮説

報道を整理すると、ファンの発言には大きく3つの解釈が浮かんできます。

仮説1: 循環投資モデルの限界

MIT Sloan教授のMichael CusumanoはFinancial Timesに対し、NvidiaのOpenAI出資を「kind of a wash(実質チャラ)」と評しています。NvidiaがOpenAIに出資 → OpenAIがそのお金でNvidiaのGPUを購入 → お金が一巡するだけ、という構造。

ただしNvidiaの粗利率は75%なので、$100億出資して$100億分のGPU注文を受ければ、実質$25億のコストで$100億の株式+$75億の利益を得る計算。それでも「投資」としての実態が薄いことには変わりません。

仮説2: IPOを見据えた利益相反の回避

ファン自身が理由として「彼らはIPOするから(they’re going to go public)」と述べています。OpenAIは営利法人への転換を進めており、Anthropicも2026年内のIPOを模索中。Nvidiaが大口サプライヤーでありながら出資者でもある状態は、IPO審査で利益相反の懸念を生みます。

この仮説に立てば、出資縮小は「関係の悪化」ではなく「上場に向けた正常化」と読めます。

仮説3: Anthropicとの政治的緊張

見落とされがちですが、水面下ではAnthropicとNvidiaの関係が悪化しています。2026年1月のダボス会議で、Anthropic CEOのDario Amodeiが「米国チップ企業が中国の承認済みバイヤーにAIチップを販売する行為」を「北朝鮮に核兵器を売るようなもの」と発言。名指しはしていませんが、明らかにNvidiaを指しています。

さらに2月27日にはトランプ政権がAnthropicを「サプライチェーンリスク」に指定。Anthropicが自律型兵器や国内大量監視への利用を拒否したことが理由とされています。Nvidiaとしては、政治的リスクを抱える企業との資本関係維持は不利と判断した可能性があります。

仮説4: 自社推論インフラへの集中

NvidiaはNIM(NVIDIA Inference Microservices)を中心に、AIモデルをエンタープライズに届けるための推論インフラレイヤーを自社で構築しようとしています。

モデル企業への出資を縮小し、自社のプラットフォームに投資を集中させる。OpenAI・Anthropicを「切る」のではなく「対等以上の立場に立つ」ための布石という解釈です。

仮説5: AI半導体競争の激化への対応

AMD、Google TPU、Amazon Trainium、さらにはOpenAI自身の独自チップ開発。Nvidiaを取り巻く競争環境は急速に変化しています。

特にOpenAIが独自チップ開発に数百億ドル規模の投資を計画しているという報道は、Nvidiaにとって「顧客が競合になる」という構図。この状況で出資を続ける経済合理性は薄れているとも読めます。

開発者コミュニティの反応

Hacker Newsでの議論

Hacker Newsのスレッドでは、懐疑的なコメントが目立ちました。

NvidiaはOpenAIなしには今の地位を得られなかった。関係を「縮小」するという表現自体が曖昧すぎる

出資を減らすのは普通のことだが、なぜ今このタイミングで公言したのかが気になる。何か別の動きを隠しているのでは

モデル企業への投資よりも、自社のNIMエコシステムに集中するほうが理にかなっている

最後のコメントが示唆に富んでいます。Nvidiaの本当の狙いは、GPU販売だけでなく推論プラットフォーム全体を握ることにあるのかもしれません。

Redditの反応

r/technologyやr/investingでは、Nvidia株への影響を懸念する投稿が見られました。一方でr/MachineLearningでは「モデル企業とインフラ企業の役割分離は健全な方向」という冷静な意見も。

開発者寄りのコミュニティでは「Nvidiaのロックインが弱まるなら歓迎」という声が多い印象です。AMD ROCmやGoogleのTPUが選択肢として実用レベルに近づいていることも、この楽観論の背景にあります。

AI半導体競争の最新状況

Nvidiaの動きを理解するには、AI半導体市場全体の変化を把握する必要があります。

Google TPU

Googleは第6世代のTPU(Trillium)を2025年後半に発表。自社のAIサービス(Gemini等)だけでなく、Google Cloud経由で外部顧客にも提供。推論コストではNvidiaのGPUに対して明確なコスト優位性を主張しています。

Amazon Trainium

AWSのカスタムAIチップ「Trainium2」は2025年にGA(一般提供)を開始。Anthropicが主要ユーザーの一つで、Claude の推論の一部はTrainium上で動いているとされています。AWS内でNvidiaのGPUからTrainiumへの移行が進むことは、Nvidiaの収益に直接影響します。

AMD MI300X / MI400

AMDのMI300Xは、NvidiaのH100に対する唯一の現実的な競合GPU。ROCmソフトウェアスタックの成熟度では依然としてCUDAに劣るものの、価格性能比では競争力を持ち始めています。MI400シリーズは2026年後半の投入が予定されています。

OpenAIの独自チップ開発

OpenAIはSoftBank、Oracleと共同で「Stargate」プロジェクト($500億規模)を推進中。自社でAIインフラを垂直統合する動きで、長期的にはNvidiaへの依存を大幅に減らす意図が明確です。

日本のBtoB企業への示唆

この動きから読み取れるのは、AIの「モデル」と「インフラ」の分離が加速しているということです。

ベンダーロックインリスクの再評価

OpenAIやAnthropicのAPI依存が深まるほど、モデル企業の資金調達状況・価格改定・利用規約変更の影響を直接受けます。Nvidiaでさえ距離を置き始めた相手への一社依存は、リスク評価が必要です。

推論コストの見直し時期

NvidiaがNIMを中心に推論インフラに本腰を入れれば、クラウドAPIコストと自社推論基盤のコスト比較軸が変わります。月間APIコストが$10,000を超えている企業は、自社推論基盤を試算に入れるタイミングかもしれません。

マルチモデル戦略の必要性

OpenAI・Anthropic以外のモデル(Mistral、Meta Llama、Qwen系など)をサブ環境で動かしておき、切り替えコストを事前に把握しておくことが、リスクヘッジとして重要になっています。

今週のアクションポイント

- 自社で利用中のAIモデルAPIのコスト推移を月次で可視化する

- 利用規約・価格改定の通知を確実に受け取れる体制を整備する

- NIMなど、モデル企業に依存しない推論インフラの情報収集を始める

- Mistral、Llama、Qwen系モデルをサブ環境でテスト運用しておく

ジェンセン・ファンの曖昧な発言は、むしろ何かが水面下で動いているサインと読むべきです。続報は随時ウォッチしていきます。